Dans l’espace numérique, l’information circule à une vitesse inédite. Les réseaux sociaux permettent à chacun de diffuser des contenus en quelques secondes auprès d’un public mondial, favorisant les échanges d’idées à grande échelle. Pourtant, ils facilitent aussi la propagation de contenus trompeurs. Avec l’essor de l’intelligence artificielle (IA), cette réalité a franchi un nouveau cap : des outils capables de générer automatiquement des textes, images et vidéos rendent la désinformation plus rapide, moins coûteuse et souvent plus sophistiquée.

Dans ce contexte, il est essentiel de distinguer deux dimensions complémentaires : l’IA générative, qui produit les contenus, et les algorithmes de recommandation, qui en déterminent la visibilité. Face à ces risques, il devient urgent d’encadrer les outils d’IA générative tout en renforçant la transparence des algorithmes. Une coopération entre États, institutions internationales et plateformes numériques s’impose pour limiter la désinformation et préserver l’intégrité du débat public.

Comment l’intelligence artificielle transforme la désinformation

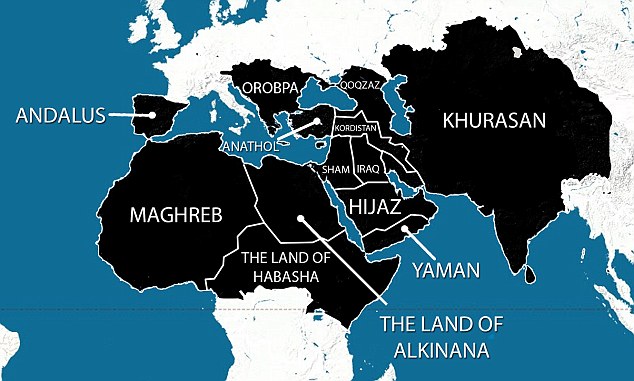

Si la désinformation n’est pas nouvelle, l’IA en a radicalement changé l’échelle et la sophistication. Les gouvernements, les groupes politiques et certains acteurs privés ont longtemps recouru à des informations fausses pour influencer l’opinion publique. Toutefois, les technologies d’intelligence artificielle ont profondément transformé l’ampleur et la sophistication de ces pratiques.

L’un des exemples les plus visibles concerne les deepfakes. Il s’agit de vidéos ou d’enregistrements audio générés par des systèmes d’IA qui imitent l’apparence ou la voix d’une personne réelle. Ces contenus peuvent donner l’impression qu’un dirigeant politique a prononcé un discours ou tenu des propos qu’il n’a jamais prononcés. Un exemple marquant est la vidéo truquée du président ukrainien Volodymyr Zelensky, diffusée en 2022, qui le montrait appelant ses soldats à se rendre face à la Russie. Bien que la vidéo ait été rapidement identifiée comme fausse, elle illustre le potentiel de ces technologies à semer la confusion dans un contexte de guerre.

Plus récemment, une enquête de la BBC a révélé que, lors des conflits au Moyen-Orient, des vidéos générées par l’IA représentant de fausses attaques ou des explosions ont circulé massivement sur les réseaux sociaux, atteignant parfois des millions de vues. Ces enquêtes mettent également en lumière l’existence de véritables « fermes de contenu » au Vietnam, où des créateurs produisent en masse des images et des vidéos générées par l’IA pour maximiser l’engagement et les revenus publicitaires. Ces contenus, souvent créés en quelques minutes, peuvent paraître très réalistes, ce qui rend leur identification particulièrement difficile et contribue à semer le doute parmi les internautes.

Si les deepfakes illustrent de manière frappante la capacité de l’IA à produire des contenus visuels trompeurs, ils ne représentent qu’une partie du phénomène. De plus, les modèles de langage de grande taille, comme ChatGPT, ont considérablement réduit les barrières techniques à la production de propagande. Ils permettent de générer rapidement des textes variés et adaptés à différents publics. Autrefois, la création de campagnes de désinformation exigeait du temps et un certain niveau d’expertise. Aujourd’hui, un acteur malveillant peut créer facilement du contenu imitant le style d’un politicien, d’un journaliste ou d’un citoyen ordinaire. Cette capacité permet de diffuser des récits trompeurs à grande échelle, tout en rendant leur détection plus difficile.

Au-delà de la création des contenus, l’IA transforme aussi la manière dont ils circulent en ligne, en permettant leur diffusion très rapide. Par exemple, elle peut créer des comptes automatisés sur les réseaux sociaux. Ces comptes, appelés « bots », publient et partagent un grand nombre de messages pour faire croire qu’une opinion est largement partagée. Pendant la pandémie de COVID-19, des études ont montré que ces bots ont largement contribué à diffuser de la désinformation en ligne, parfois en relayant massivement des théories complotistes ou de fausses informations sur les vaccins. En réalité, ces messages sont souvent coordonnés et diffusés automatiquement. Leur objectif : influencer l’opinion publique ou attaquer des adversaires politiques.

Qui gouverne les algorithmes ?

Pour comprendre qui contrôle les algorithmes, il faut d’abord se demander à qui ils profitent réellement. Les gouvernements et, surtout, les grandes entreprises technologiques jouent un rôle clé dans le contenu que nous voyons en ligne. Pour cela, ils s’appuient sur des algorithmes qui organisent et recommandent les contenus.

En pratique, les entreprises comme Meta et TikTok cherchent principalement à maximiser l’engagement des utilisateurs, puisqu’un temps d’utilisation plus élevé se traduit par des revenus publicitaires accrus. Par conséquent, les algorithmes tendent à mettre en avant des contenus qui retiennent fortement l’attention, notamment ceux qui suscitent des émotions intenses, ce qui accroît leur probabilité d’être partagés et donc amplifiés par les plateformes. Cela peut inclure des informations trompeuses ou des contenus générés par l’IA, tels que les deepfakes. Même lorsque ces contenus sont inexacts, ils bénéficient souvent d’une plus grande visibilité en raison des réactions qu’ils suscitent.

Le fonctionnement précis de ces algorithmes, développés par de grandes entreprises, reste en grande partie secret pour des raisons commerciales ou de sécurité. Ce manque de transparence peut devenir problématique lorsque ces algorithmes influencent fortement la circulation de l’information publique. Par exemple, en 2025, le Défenseur des droits, une autorité administrative indépendante en France, a conclu que l’algorithme de Facebook entraînait une discrimination indirecte fondée sur le genre dans la diffusion d’offres d’emploi. Certaines annonces, comme celles pour des postes de mécaniciens, étaient principalement montrées à des hommes, tandis que d’autres, comme les emplois en petite enfance, étaient davantage présentées à des femmes.

Cette situation montre que les algorithmes ne sont pas neutres. Ils peuvent reproduire ou même amplifier des biais existants sans que les utilisateurs s’en rendent compte. Ils peuvent également favoriser certains discours et marginaliser d’autres. Dans ce contexte, l’absence de transparence rend ces mécanismes difficiles à comprendre, tant pour les chercheurs que pour les citoyens. Ainsi, la question de la responsabilité devient centrale. Si les algorithmes influencent la visibilité des informations et, par conséquent, le débat public, il faut se demander dans quelle mesure les plateformes numériques doivent être tenues responsables de leurs effets.

Dans les pays membres de l’OTAN, cette question est particulièrement complexe. D’un côté, les démocraties cherchent à rendre les algorithmes plus transparents afin de protéger le public et de limiter la désinformation. De l’autre, de nombreux spécialistes de la cybersécurité craignent qu’une transparence excessive permette aux acteurs malveillants de mieux manipuler ces algorithmes. Il existe donc une tension entre le besoin de transparence et les préoccupations de sécurité. Un équilibre délicat entre l’ouverture et la sécurité nationale reste à trouver.

Le rôle et les limites de l’OTAN

L’OTAN reconnaît l’importance croissante de l’intelligence artificielle pour la sécurité internationale. Sa stratégie révisée en 2024 met l’accent sur une IA « responsable » et sur le respect de principes tels que la légalité, la gouvernance, l’atténuation des biais, l’intelligibilité, la traçabilité et la fiabilité des systèmes. Elle prévoit aussi des initiatives concrètes, telles que les Défis et l’innovation de l’Accélérateur d’innovation de défense pour l’Atlantique Nord (DIANA) et le fonds d’innovation de l’OTAN, destinées à soutenir le développement de technologies avancées. Toutefois, ces instruments sont principalement conçus pour soutenir l’innovation technologique dans le domaine de la défense, et non pour encadrer ou réglementer les pratiques des grandes entreprises technologiques.

Dans cette perspective, cette stratégie présente de nombreuses limites. Elle reste principalement centrée sur les applications militaires de l’IA, alors que la désinformation se diffuse surtout sur des plateformes civiles comme les réseaux sociaux. L’OTAN reconnaît la menace des opérations d’information, c’est-à-dire des campagnes visant à influencer l’opinion publique ou à diffuser de la désinformation, mais elle ne propose pas de mécanismes précis pour encadrer les algorithmes des grandes entreprises technologiques, qui jouent pourtant un rôle central dans la diffusion de ces contenus.

De plus, en tant qu’organisation intergouvernementale, l’OTAN ne peut imposer de règles contraignantes ni à ses États membres ni aux entreprises privées. Toute décision repose sur le consensus, ce qui peut ralentir l’action collective face à des menaces rapides et évolutives. Enfin, plusieurs principes évoqués dans la stratégie, tels que la transparence ou la responsabilité, demeurent généraux et difficiles à mettre en pratique. Cela limite la capacité de l’OTAN à répondre efficacement aux défis que pose l’IA dans la circulation de l’information.

Vers une réponse collective

L’essor de l’intelligence artificielle a profondément transformé la production, la diffusion et la visibilité de l’information en ligne, facilitant la propagation de la désinformation. Face à ces défis, aucune solution unique ne suffit. Les États, les institutions internationales et les entreprises technologiques doivent agir de manière complémentaire. Dans ce contexte, des organisations comme l’OTAN peuvent jouer un rôle de coordination utile, mais elles ne peuvent pas, à elles seules, répondre à l’ensemble du problème.

L’enjeu n’est donc plus seulement de reconnaître les risques liés à l’intelligence artificielle, mais de mettre en place des mécanismes concrets pour en limiter les effets. Cela implique, pour les plateformes, de rendre visibles les critères déterminant la diffusion des contenus et de mieux encadrer l’usage des outils génératifs ; pour les États, de définir des obligations claires en matière de transparence et de responsabilité ; et pour les organisations internationales, d’assurer une coordination cohérente entre ces différentes approches. Sans avancées concrètes dans ces domaines, les capacités de production et d’amplification de la désinformation continueront d’évoluer plus rapidement que les cadres destinés à les réglementer.

Disclaimer: Any views or opinions expressed in articles are solely those of the authors and do not necessarily represent the views of the NATO Association of Canada.

Photo: Wikimedia Commons (Public Domain).